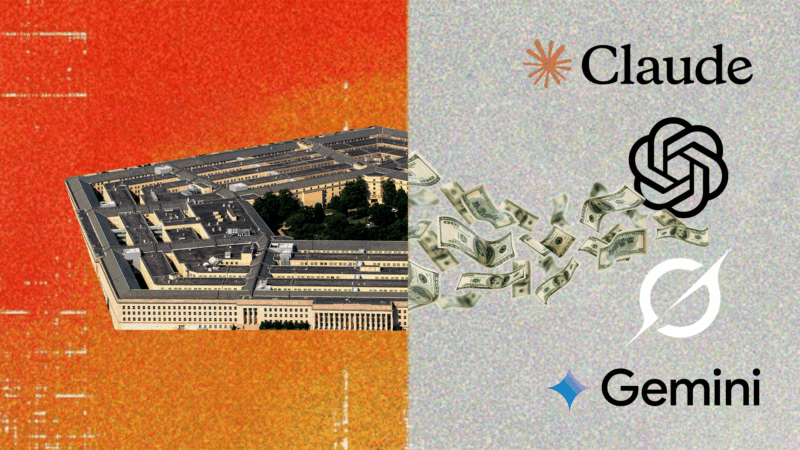

1. 펜타곤이 ‘클로드’를 탐내는 이유

미 국방부는 지금 AI 도입에 사활을 걸고 있습니다. 전쟁의 양상이 바뀌었기 때문입니다. 드론을 조종하고, 위성 사진을 분석하고, 적의 사이버 공격을 막아내는 데 AI만큼 훌륭한 무기는 없습니다.

그중에서도 국방부가 앤스로픽의 ‘클로드 3.5(Claude 3.5)’ 시리즈를 특히 눈독 들이는 이유는 ‘정확성’과 ‘긴 문맥 이해 능력’ 때문입니다. 수만 장의 기밀 문서를 한 번에 읽고 전략을 짜는 데 클로드가 타의 추종을 불허하기 때문이죠.

2. 무엇이 문제인가요? (헌법 AI vs 국가 안보)

하지만 앤스로픽은 다른 AI 기업들과 다릅니다. 이 회사의 정체성은 ‘헌법적 AI(Constitutional AI)’에 있습니다.

- 앤스로픽의 입장: “우리 AI는 ‘해로움(Harm)’을 끼치는 데 쓰일 수 없다. 사람을 죽이거나, 생화학 무기를 만드는 정보에 AI가 관여하는 것은 우리 헌법 위반이다.”

- 펜타곤의 입장: “국가 안보를 지키는 일이다. 적국은 AI를 무기로 쓰고 있는데, 우리가 윤리 따지느라 뒤처지면 나라가 위험해진다. 예외를 인정해 달라.”

테크크런치에 따르면, 양측은 클로드의 ‘사용 권한(Terms of Service)’을 두고 고성을 오가며 논쟁 중입니다. 국방부는 더 자유로운 사용 권한을 원하고, 앤스로픽은 엄격한 제한(Guardrail)을 풀지 않으려 합니다.

3. 왜 오픈AI와는 다를까요?

사실 오픈AI(챗GPT)나 구글 등은 이미 국방부와 협력을 시작했습니다. 물론 “살상 무기 개발에는 안 쓴다”는 단서를 달았지만, 사이버 보안이나 행정 업무 등에서는 비교적 유연하게 협조하고 있습니다.

하지만 앤스로픽은 태생 자체가 오픈AI의 상업화에 반대해서 나온 사람들이 만든 회사입니다. “안전하지 않은 AI는 만들지 않느니만 못하다”는 철학이 워낙 강해서, 이번 국방부와의 갈등은 쉽게 봉합되지 않을 것으로 보입니다.

4. 이 싸움이 중요한 이유

이것은 단순히 한 회사와 정부의 싸움이 아닙니다. 미래 AI 산업의 기준점을 정하는 싸움입니다.

만약 앤스로픽이 굴복한다면? -> “결국 돈과 권력 앞에서는 AI 윤리도 소용없구나”라는 선례를 남기게 됩니다.

만약 앤스로픽이 끝까지 버틴다면? -> “기술 기업이 정부의 통제를 거부하고 독자적인 윤리 기준을 지킬 수 있다”는 것을 증명하게 됩니다. 하지만 국방부와의 거대한 계약(돈)을 포기해야 하니 경영상으로는 큰 손해를 보겠죠.

5. 심층 분석 정리

“우리는 지금 딜레마에 빠져 있습니다. 착한 AI만 만들자니 적들의 위협이 무섭고, AI에게 총을 쥐여주자니 통제 불능이 될까 봐 두렵습니다. 앤스로픽의 저항은 ‘AI의 군사화’라는 거대한 흐름 앞에서 ‘최소한의 브레이크’를 걸어보려는 마지막 자존심일지도 모릅니다.”